Branchenbeobachter sind sich in einem Punkt einig: Das Jahr 2026 markiert einen Umschwung in der Natur von Cyberangriffen. Künstliche Intelligenz unterstützt die Angreifer nicht mehr nur, sondern automatisiert den gesamten Zyklus des Eindringens. Gleichzeitig wandelt sich Ransomware weiter in Richtung immer raffinierterer Erpressungsmuster, während kritische Infrastrukturen zu vorrangigen Zielen werden. Eine Querschnittsanalyse der Prognosen der wichtigsten Akteure im Bereich Cybersicherheit zeigt die Trends auf, die die nächsten zwölf Monate prägen werden.

Table des matières

ToggleWie KI die Methoden von Cyberkriminellen verändert.

Malware, die in Echtzeit lernt und sich anpasst.

Die neuen Generationen von Ransomware verfügen über Lernfähigkeiten, die es ihnen ermöglichen , die von ihnen infiltrierten Umgebungen zu analysieren und ihr Verhalten entsprechend anzupassen. Dmitry Volkov, CEO von Group-IB, erwartet das Aufkommen einer neuen Generation von Malware, die sich selbstständig verbreiten kann, ähnlich wie historische Computerwürmer wie WannaCry oder NotPetya, aber mit einer nie dagewesenen Raffinesse. Diese neuen Varianten sondieren ihre Ziele, wählen die zu kompromittierenden Systeme aus und passen ihre Ausweichtechniken je nach den angetroffenen Verteidigungen an, um der herkömmlichen Erkennung zu entgehen.

Durch die Integration von immer leistungsfähigerer KI wird diese Malware in der Lage sein, die gesamte Kill Chain zu automatisieren: Entdeckung von Sicherheitslücken, Ausnutzung, Seitwärtsbewegung und Koordination von Großoperationen. Diese Automatisierung reduziert drastisch die verfügbare Zeit für Verteidigungsteams, die nun mit der Geschwindigkeit von Algorithmen statt mit der von menschlichen Operatoren reagieren müssen.

Massenhafte Phishing-Angriffe

Die Industrialisierung von Phishing-Angriffen erreicht eine neue Stufe. Manuelle Eingriffe sind nicht mehr nötig, da Systeme mit künstlicher Intelligenz ultrapersonalisierte Phishing-Kampagnen erstellen, indem sie die öffentlichen Profile, den Chatverlauf und das berufliche Netzwerk ihrer Ziele auswerten. Diese Massenpersonalisierung, gepaart mit der Produktion von Tausenden von Varianten in Sekundenschnelle, macht die Erkennung durch herkömmliche Filter zunehmend unsicher.

Laut Bitdefender liegt die Gefahr jedoch nicht nur in der offensiven Nutzung von KI. Dieunkoordinierte Übernahme von KI-Tools durch Mitarbeiter schafft eine beträchtliche Angriffsfläche, die Organisationen nur schwer unter Kontrolle bringen können. Mitarbeiter nutzen mitunter nicht autorisierte KI-Dienste, teilen sensible Daten mit Drittplattformen und umgehen etablierte Sicherheitsrichtlinien, oft ohne die Konsequenzen zu bedenken. Diese mangelhafte Governance der internen KI stellt eine große Schwachstelle dar, da sie das Unternehmen Datenlecks und Datenschutzverletzungen aussetzt, ohne dass ein Eindringen von außen erforderlich ist.

Diese unternehmenseigenen KI-Systeme weisen auch inhärente Schwachstellen auf. Mit Prompt-Injection-Angriffen lässt sich das Verhalten von KI-Assistenten manipulieren, indem bösartige Anweisungen in die von ihnen verarbeiteten Dokumente oder Daten injiziert werden, wodurch legitime Tools unbemerkt vom Benutzer in Angriffsvektoren verwandelt werden.

Social Engineering erreicht eine neue Stufe.

KI macht die üblichen Warnsignale unsichtbar.

Eine der besorgniserregendsten Entwicklungen betrifft die Perfektionierung des KI-gestützten Social Engineering. Grammatikfehler, ungeschickte Formulierungen und Übersetzungsfehler, die früher Phishing-Versuche verrieten, gehören heute der Vergangenheit an. Sprachmodelle (LLM) erzeugen perfekt verfasste, kontextuell passende und psychologisch manipulative Kommunikation, die es immer schwieriger macht, zwischen legitimer Nachricht und Betrugsversuch zu unterscheiden.

Sprachklonierung und Deepfakes als gefährliche Waffen

Das Klonen von Sprache stellt heute eine der profitabelsten Bedrohungen für Angreifer dar. Mit nur wenigen Sekunden einer Audioaufnahme, die leicht über soziale Netzwerke oder institutionelle Websites zugänglich ist, können Cyberkriminelle die Stimme einer Führungskraft verblüffend genau reproduzieren. Diese Technik ist besonders effektiv bei Telefonbetrügereien (Voice Phishing), bei denen es vor allem um die Validierung von Überweisungen und die Genehmigung sensibler Transaktionen geht.

Auch Video-Deepfakes gewinnen an Qualität, obwohl die Produktionskosten immer noch höher sind. Laut Bitdefender sind diese Techniken jedoch nur für Angriffe auf Ziele mit hohem Gewinnpotenzial geeignet.

Techniken, die das Vertrauen der Benutzer missbrauchen, gewinnen an Boden.

Parallel zu diesen technologischen Neuerungen umgehen einfache, aber effektive Techniken wie ClickFix weiterhin die technischen Abwehrmechanismen, indem sie das Vertrauen der Benutzer in vertraute Benutzeroberflächen missbrauchen. Diese Angriffe basieren auf glaubwürdigen Szenarien, die die Opfer dazu verleiten, absichtlich bösartigen Code auszuführen, da sie glauben, ein legitimes technisches Problem zu lösen. Mit falschen Systemfehlermeldungen oder fingierten Update-Benachrichtigungen nutzen die Angreifer die Reflexe der Internetnutzer aus und machen sie zu unfreiwilligen Komplizen ihrer eigenen Infektionen.

Ransomware automatisiert ihre Operationen.

Ein kriminelles Ökosystem, das wie ein Unternehmen strukturiert ist.

Ransomware-as-a-Service (RaaS) funktioniert wie ein echtes organisiertes Geschäftsmodell, das Entwickler, Affiliates und Toolanbieter in einem nebulösen, aber strukturierten Ökosystem vereint. Alle diese Akteure arbeiten nach einer Effizienzlogik: „Maximierung der Wirkung und Minimierung der Zeit und des Aufwands, die für die Störung erforderlich sind„, wie Dmitry Volkov schreibt. Konzerne wie DragonForce verkörpern diese Industrialisierung bereits mit ihrem White-Label-Modell, das den Zugang zu ausgeklügelten Angriffen demokratisiert.

KI senkt die Eintrittsbarriere für Affiliates.

KI-Agenten werden allmählich in RaaS-Angebote integriert und machen fortgeschrittene automatisierte Fähigkeiten auch für wenig qualifizierte Affiliates zugänglich. Sobald das Eindringen in das Netzwerk ihrer Beute etabliert ist, übernehmen diese Agenten die interne Erkennung, die Erhöhung von Privilegien und die Vorbereitung der Verschlüsselung, ohne dass tiefergehendes technisches Fachwissen erforderlich ist.

Die derzeitige Automatisierung umfasst bereits die schnelle Verschlüsselung virtualisierter Infrastrukturen, die automatische Vernichtung von Backups und die Deaktivierung von Abwehrlösungen. Die Integration von KI verstärkt diese Dynamik, indem sie es kriminellen Gruppen ermöglicht, mit minimalem Personalaufwand mehrere Operationen gleichzeitig durchzuführen und so den Pool an Akteuren zu erweitern, die in der Lage sind, groß angelegte Kampagnen durchzuführen.

Die Erpressung wird vielfältiger und perfekter.

Von der einfachen Verschlüsselung zu facettenreichen Strategien.

Das rein auf Verschlüsselung basierende Erpressungsmodell tritt gegenüber Ansätzen zurück, die Datendiebstahl, drohende Veröffentlichung, selektive Verschlüsselung und manchmal Denial-of-Service-Angriffe (DDoS) kombinieren. Dieser hybride Ansatz vervielfacht den Druck auf die Opfer, indem er gleichzeitig mehrere Schwachstellen ausnutzt.

Das Erpressungsmodell, das nur auf Verschlüsselung beruht, ist auf dem Rückzug. Die doppelte Erpressung, die Verschlüsselung und Datendiebstahl mit Veröffentlichungsdrohungen kombiniert, hat den Weg für noch raffiniertere Strategien geebnet: selektive Verschlüsselung, massive Exfiltration und manchmal Denial-of-Service-Angriffe(DDoS). Dieser hybride Ansatz vervielfacht den Druck auf die Opfer, indem er gleichzeitig mehrere Schwachstellen ausnutzt.

Cyberkriminelle treiben diese Logik noch weiter. Tom Egglestone von Resilience beobachtet, dass die Gruppen nicht mehr nur eine einzige Organisation ins Visier nehmen, sondern gleichzeitig das Unternehmen, seine Tochtergesellschaften, seine Zulieferer und manchmal auch seine Kunden kompromittieren. Dieses Geflecht aus Querdruck beschleunigt den Reputations- und Betriebsschaden, macht die Position des Opfers unhaltbar und erhöht gleichzeitig die Wahrscheinlichkeit einer Zahlung erheblich.

Erpressung ohne Verschlüsselung auf dem Vormarsch

Dr. Ann Irvine, Chief Data and Analytics Officer bei Resilience, beobachtet einen Trend: Böswillige Akteure verzichten zunehmend auf Verschlüsselung und fordern stattdessen direkt Geld für die Nichtoffenlegung gestohlener Daten. Dies verändert dann die Art der Bedrohung. Herkömmliche Wiederherstellungsstrategien, insbesondere Backups, werden angesichts des Risikos, dass sensible Informationen wie Kundendaten, Geschäftsgeheimnisse oder vertrauliche Mitteilungen öffentlich zugänglich gemacht werden, unwirksam.

Die Lieferkette als Achillesferse von Organisationen

Die Lieferkette wird zu einem wichtigen Angriffsvektor. Angreifer haben erkannt, dass die Kompromittierung eines Anbieters mit privilegiertem Zugang zu mehreren Kunden eine weitaus rentablere Investition darstellt, als jede Organisation einzeln ins Visier zu nehmen. Ein einziger Einbruch bei einem Anbieter kann sich auf Dutzende von Unternehmenskunden ausbreiten. Shared Infrastructure (Cloud, SaaS, Managed Services) zieht immer mehr die Aufmerksamkeit von Angreifern auf sich.

Bestechung eines Mitarbeiters zur Umgehung der Verteidigung

Recorded Future berichtet von einer Zunahme der Versuche von Ransomware-Gruppen, Mitarbeiter anzuwerben. Diese bieten Mitarbeitern Geld im Austausch für Logins oder sensible Informationen an. So wurde ein Journalist der BBC direkt von Cyberkriminellen angesprochen. Dieser Ansatz umgeht die technischen Abwehrmaßnahmen vollständig, indem er die menschliche Schwachstelle ausnutzt.

AiTM-Angriffe, die durch KI automatisiert werden.

Wenn die Multi-Faktor-Authentifizierung nicht mehr ausreicht.

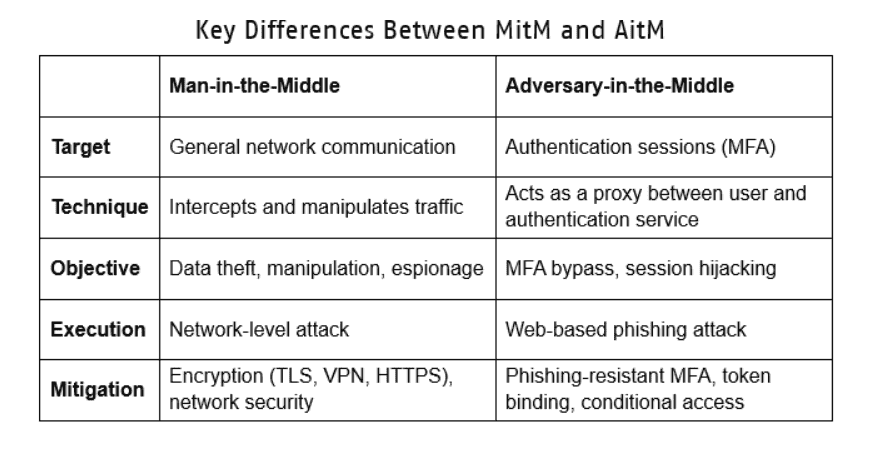

Adversary-in-the-Middle-Angriffe (AiTM) werden bei Cyberkriminellen immer beliebter. Diese Angriffe stehlen nicht nur Anmeldeinformationen, sondern fangen auch bereits authentifizierte Sitzungen ab und nutzen sie aus. Wenn sich ein Benutzer rechtmäßig bei einem durch Multi-Faktor-Authentifizierung geschützten Dienst anmeldet, fängt der Angreifer das gültige Sitzungs-Token ab und verwendet es, um auf Systeme zuzugreifen, ohne jemals das Passwort oder den zweiten Faktor zu benötigen. Im Januar 2026 dokumentierte Microsoft eine mehrstufige AiTM-Kampagne, die auf den Energiesektor abzielte und bei der über ein einziges kompromittiertes Konto mehr als 600 Phishing-E-Mails über SharePoint versendet wurden.

Derzeit erfordern diese AiTM-Operationen einen hohen manuellen Verwaltungsaufwand, um kompromittierte Sitzungen aufrechtzuerhalten und Authentifizierungsmechanismen zu umgehen. Doch die Integration von KI in diese Frameworks verändert die Situation. Laut Group-IB werden Angreifer im Jahr 2026 KI integrieren, um das Umleiten von Sitzungen und das Sammeln von Anmeldeinformationen in großem Umfang zu automatisieren. Die Verifikationssysteme, die wir heute verwenden – Zwei-Faktor-Authentifizierung, Biometrie, passwortlose Systeme – werden angesichts KI-gesteuerter AiTM-Operationen, die anpassungsfähiger sind als die heutigen Abwehrmaßnahmen, unwirksam werden. Nur phishing-resistente Authentifizierungsmethoden wie FIDO2/WebAuthn, die die Authentifizierung über Public-Key-Kryptografie mit dem Gerät verknüpfen, können AiTM-Angriffen standhalten, da keine IDs oder Token über das Netzwerk übertragen werden.

Cloud-APIs als neue Oberfläche für massive Angriffe.

Wenn Cloud-Automatisierung zur Schwachstelle wird.

Moderne Unternehmen verlassen sich massiv auf Cloud- und API-Ökosysteme, um Wachstum und Effizienz freizusetzen. APIs, die für die Automatisierung konzipiert sind, ermöglichen durch ihre maschinengesteuerten Schnittstellen die Orchestrierung von Vorgängen in einem nie dagewesenen Ausmaß. Doch diese Effizienz hat eine Kehrseite: KI-gesteuerte Bedrohungen können dieselben Schnittstellen ebenfalls ausnutzen. Im Jahr 2025 hat Palo Alto Networks einen Anstieg der Angriffe auf APIs um 41% festgestellt, ein Trend, der direkt mit der Explosion der agentischen KI zusammenhängt, die sich massiv auf diese Schnittstellen stützt.

Cloud-Umgebungen werden durch Code gesteuert. Berechtigungen, Speicher, Netzwerkeinstellungen und Sicherheitsrichtlinien werden über APIs definiert, was diese Konfigurationen maschinenlesbar macht. Künstliche Intelligenz kann daher Cloud-Konfigurationen verstehen und sogar verändern, indem sie diese APIs ausnutzt. Angreifer werden diese automatisierte Schicht anvisieren, um massive Störungen zu verursachen, Kontrolloberflächen freizulegen oder kritische Konfigurationen zu verändern. Gartner, das weltweit führende Forschungsunternehmen für Technologie und Cybersicherheit, prognostiziert sogar, dass bis 2026 80% aller Datenverletzungen unsichere APIs betreffen werden, was diese Automatisierungsschicht zum kritischsten Schwachpunkt der Cloud-Infrastruktur macht.

Diese Dynamik schafft ein neues Schlachtfeld, auf dem APIs beiden Seiten – Angreifern und Verteidigern – die Fähigkeit verleihen, ihre Operationen in der Cloud unbegrenzt zu vervielfachen. Den Vorteil wird derjenige haben, der über die Rechenleistung und die Ressourcen verfügt, um diese Skalierbarkeit auszunutzen.

OAuth-Angriffe: Der Dominoeffekt zwischen Cloud-Anwendungen

Vernetzte SaaS-Umgebungen schaffen ein Vertrauensnetz zwischen Anwendungen: Microsoft 365, Google Workspace, Slack und Salesforce tauschen über OAuth Berechtigungen aus. OAuth-Kompromittierungen nutzen genau dieses Vertrauensgeflecht aus. Ein Angreifer, der einen Benutzer dazu bringt, einer bösartigen Anwendung Berechtigungen zu erteilen, erhält einen legitimen Ankerpunkt. Diese kompromittierte Anwendung kann sich dann unter Ausnutzung der bestehenden Vertrauensbeziehungen lateral zwischen Diensten verbreiten, ohne dass Passwörter oder eine Multi-Faktor-Authentifizierung erforderlich sind.

Diese Bedrohung nahm im August 2025 mit der Kompromittierung der Anwendung Salesloft Drift eine konkrete Dimension an. Die Angreifer nutzten gestohlene OAuth-Token, um auf Hunderte von Salesforce-Instanzen und Google Workspace-Konten zuzugreifen, und demonstrierten, wie eine einzige kompromittierte Anwendung innerhalb weniger Stunden das gesamte SaaS-Ökosystem eines Unternehmens verseuchen kann.

Unsichtbare Backdoors in KI-gestütztem Code.

Künstliche Intelligenz verändert die Praktiken der Softwareentwicklung. Codierungsassistenten beschleunigen die Produktion erheblich, aber das wachsende Vertrauen in KI-generierten Code verringert die Strenge der Reviews. Viele Teams lassen den Code nun schneller in die Produktionsumgebungen gelangen und vernachlässigen dabei die gründlichen Überprüfungen, die Anomalien aufgedeckt hätten.

Diese Entwicklung erhöht das Risiko von Supply-Chain-Angriffen. Gegner fügen schwer zu entdeckende Backdoors in legitime Software und beliebte Bibliotheken ein, die von Tausenden von Entwicklern genutzt werden. Mit der zunehmenden Bedeutung von KI-gestützten Codierungswerkzeugen könnten staatliche Akteure versuchen, diese Systeme zu beeinflussen oder zu manipulieren, um Backdoors und Schwachstellen in großem Umfang zu integrieren.

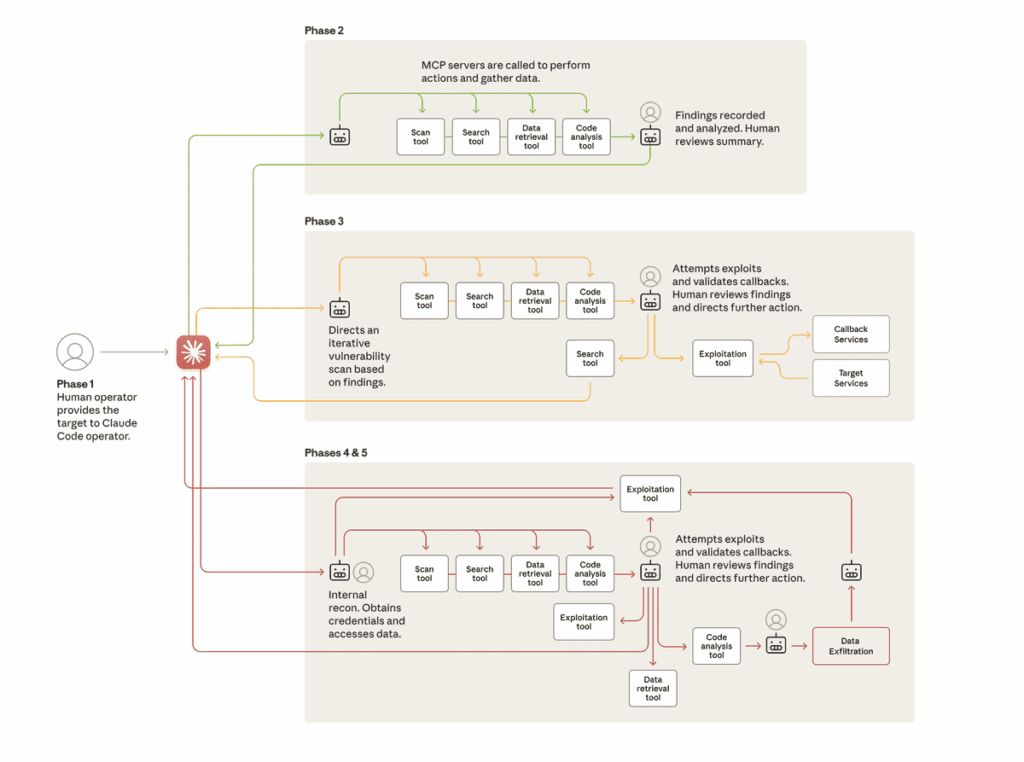

Group-IB weist darauf hin, dass diese Kombination aus weit verbreiteter Einführung und geringerer Prüfung eine sich entwickelnde Möglichkeit für Gegner darstellt , Entwicklungssysteme und -pipelines zu kompromittieren, eine Gelegenheit, die sie wahrscheinlich nicht übersehen werden. Diese Vorhersage wurde im September 2025 auf spektakuläre Weise wahr, als Anthropic den ersten groß angelegten KI-orchestrierten Cyberangriff entdeckte und neutralisierte. Ein böswilliger Akteur hatte Claude Code manipuliert, um 30 globale Organisationen nahezu selbstständig zu infiltrieren, und damit gezeigt, dass die Bedrohung durch KI-gestützte Backdoors nicht nur theoretischer Natur ist.

Die defensive Antwort organisiert sich

Einheitliche SOCs und Cyber-Betrug-Fusionszentren.

Angesichts der Beschleunigung von KI-gesteuerten Angriffen investieren Security Operations Centers massiv in intelligente Automatisierung, um Bedrohungen mit wettbewerbsfähiger Geschwindigkeit zu erkennen und darauf zu reagieren. Diese Entwicklung macht eine interne Zusammenarbeit nahezu in Echtzeit erforderlich, um Sicherheitslücken zu schließen.

Traditionelle SOCs, die um disparate Tools herum organisiert sind, die riesige Mengen an Warnmeldungen generieren, schaffen Antwortsilos. Dieses Modell wird allmählich von Cyber Fraud Fusion Centers abgelöst. Diese hybriden, funktionsübergreifenden Teams verbessern das Risikomanagement erheblich durch gemeinsame Daten, Dashboards mit vernetzten Einblicken, zentralisierte automatisierte Modelle zur Standardisierung und Korrelation von Informationen und Echtzeit-Feedbackschleifen, die ein sofortiges Handeln bei den ersten Anzeichen einer Bedrohung ermöglichen.

Künstliche Intelligenz spielt dabei eine zentrale Rolle, um die Sortierung und Anreicherung von Warnmeldungen zu automatisieren, sodass sich die Analysten auf komplexe Untersuchungen konzentrieren können, die Urteilsvermögen und Kreativität erfordern. Die Schlüsselwörter dieser Transformation: kontinuierlich, Echtzeit, kollaborativ.

KI-Transparenz – ein Gebot der Vertrauenswürdigkeit.

KI-Systeme werden zunehmend selbstständig sicherheitsrelevante Entscheidungen treffen. Ein Mangel an Aufsicht kann jedoch schädlich werden und zu Verzerrungen, falschen Klassifizierungen und ethischem Versagen führen. Die Transparenz und Prüfbarkeit von KI, was im englischen Sprachraum als „Explainable AI“ (XAI) bezeichnet wird, wird sich von einer Option zu einem nicht verhandelbaren Imperativ für Organisationen entwickeln, die ernsthaft KI-Kapazitäten für die Sicherheit einsetzen.

Diese Transparenz muss für die Trainingsdaten gelten, um Vergiftungen zu verhindern, für die Entscheidungslogik, um ausnutzbare Verzerrungen zu vermeiden, und für den Prozess der Ergebnisvalidierung, damit Analysten verstehen, warum das Modell auf eine bestimmte Art und Weise gehandelt hat. Trotz der Bereitschaft der Unternehmen, KI zu integrieren, sind die meisten noch nicht bereit, ihr vollständig zu vertrauen. Das Black-Box-Problem, zusätzliche Schwachstellen und Compliance-Risiken haben die schnelle Einführung von KI zu einem großen Risiko gemacht.

Dmitry Volkov erklärt: Dadurch verschiebt sich die zentrale Sicherheitsfrage von „Wo setzen Sie KI ein?“ zu „Was lassen Sie die KI entscheiden und können Sie das erklären?“.

Die Herausforderungen von morgen

Das Jahr 2026 wird keinen abrupten Bruch markieren, sondern die Beschleunigung von Trends, die bereits am Werk sind. Künstliche Intelligenz verstärkt die Fähigkeiten von Angreifern und Verteidigern gleichermaßen und schafft ein Wettrennen, bei dem die Automatisierung unverzichtbar wird. Ransomware professionalisiert sich weiter und nutzt methodisch schwache Glieder aus, um ihre Rentabilität zu maximieren. Die digitale Infrastruktur steht unter zunehmendem Druck, der ihre strategische Bedeutung widerspiegelt.

Erfolgreiche Organisationen werden diejenigen sein, die sich vom Paradigma der absoluten Prävention verabschieden und eine Haltung der Widerstandsfähigkeit einnehmen. Anstatt zu versuchen, Eindringlinge zu verhindern, bereiten sie sich darauf vor, kompromittiert zu werden, und bauen ihre Fähigkeit auf, schnell zu erkennen, wirksam einzudämmen und ihren Betrieb vollständig wiederherzustellen. Dieser Ansatz beinhaltet wirklich isolierte Backups, regelmäßig getestete Kontinuitätspläne und ein klares Verständnis der kritischen Abhängigkeiten.

Die Kontrolle des Risikos von Drittanbietern erfordert einen radikalen Wandel: kontinuierliche Überwachung der Sicherheitshaltung der Anbieter, genaue Kartierung der potenziellen Auswirkungen und Notfallpläne, die es ermöglichen, den Betrieb auch bei einem größeren Zwischenfall bei einem Anbieter aufrechtzuerhalten. Die genaue Quantifizierung der Gefährdung geht über oberflächliche Compliance-Bewertungen hinaus und bezieht den tatsächlichen Betriebsverlust, die Erosion des Kundenvertrauens und die regulatorischen Konsequenzen mit ein.

Schließlich behalten die Grundlagen ihre Relevanz: rigorose Multi-Faktor-Authentifizierung, Netzwerksegmentierung, konsequente Anwendung von Patches und kontinuierliche Schulung. Fortschrittliche Technologien kompensieren keine schwachen Grundlagen. Nur Organisationen, die eine solide Sicherheitshygiene etabliert haben, werden in der Lage sein, die von der KI gebotenen defensiven Möglichkeiten voll auszuschöpfen. Risiken sind keine hypothetischen Szenarien. Sie treffen heute Organisationen, die auf diese neue Normalität der Cyberbedrohung nicht vorbereitet waren.

Quellen

Group-IB: Stranger Threats Are Coming: Group-IB Cyber Predictions for 2026 and Beyond.

Lumu: Cybersecurity Predictions 2026: The Post-Malware & AI Era.

Bitdefender: Cybersecurity Predictions 2026: Hype vs. Realität

Cyber Resilience: Cybersecurity and Insurance Predictions 2026

Recorded Future: Ransomware Tactics 2026.

BBC News: Ransomware-Gang versucht, Journalisten als Insider einzustellen.

SecurityWeek: Cyber Insights 2026: API Security – Harder to Secure, Impossible to Ignore.

Microsoft Security Blog: Mehrstufige AiTM Phishing- und BEC-Kampagne missbraucht SharePoint.

MITRE ATT&CK®: Adversary-in-the-Middle

Swissbit: Bypassing MFA: The Rise of Adversary-in-the-Middle (AitM) Attacks.

Palo Alto Networks: Palo Alto Networks Report Reveals AI Is Driving a Massive Cloud Attack Surface Expansion.

Wowrack: Preparing for 2026 Cloud Threats: A Guide to Cloud Security Trends and Risk Management.

Google Cloud Blog: Widespread Data Theft Targets Salesforce Instances via Salesloft Drift.

Anthropic: Disrupting the first reported AI-orchestrated cyber spy campaign.

Google Cloud: Cybersecurity Forecast 2026 report