Les observateurs du secteur s’accordent sur un constat : l’année 2026 marque un basculement dans la nature même des cyberattaques. L’intelligence artificielle ne se contente plus d’assister les attaquants, elle automatise désormais l’intégralité du cycle d’intrusion. Parallèlement, les ransomwares poursuivent leur mutation vers des modèles d’extorsion toujours plus sophistiqués, tandis que les infrastructures critiques deviennent des cibles prioritaires. Une analyse croisée des prédictions émises par les principaux acteurs de la cybersécurité permet d’identifier les tendances qui façonneront les douze prochains mois.

Table des matières

ToggleComment l’IA transforme les méthodes des cybercriminels

Des malwares qui apprennent et s’adaptent en temps réel

Les nouvelles générations de ransomwares intègrent des capacités d’apprentissage qui leur permettent d’analyser les environnements qu’ils infiltrent et d’ajuster leur comportement en conséquence. Dmitry Volkov, CEO de Group-IB, anticipe l’émergence d’une nouvelle génération de malwares capables de se propager de manière autonome, à l’image des vers informatiques historiques comme WannaCry ou NotPetya, mais avec une sophistication sans précédent. Ces nouvelles variantes sondent leurs cibles, sélectionnent les systèmes à compromettre et ajustent leurs techniques d’évasion en fonction des défenses rencontrées afin d’échapper aux détections traditionnelles.

L’intégration de l’IA de plus en plus performante permettra à ces malwares d’automatiser l’intégralité de la kill chain : découverte des failles de sécurité, exploitation, mouvement latéral et coordination des opérations d’envergure. Cette automatisation réduit drastiquement le temps disponible pour les équipes de défense, qui doivent désormais réagir à la vitesse des algorithmes plutôt qu’à celle des opérateurs humains.

Des attaques de phishing en masse

L’industrialisation des attaques de phishing franchit un nouveau palier. Plus besoin d’opérations manuelles, les systèmes d’intelligence artificielle génèrent des campagnes de phishing ultra-personnalisées en exploitant les profils publics, l’historique des échanges et le réseau professionnel de leurs cibles. Cette personnalisation de masse, couplée à la production de milliers de variantes en quelques secondes, rend la détection par filtrage traditionnel de plus en plus aléatoire.

Toutefois, selon Bitdefender, le danger ne réside pas uniquement dans l’utilisation offensive de l’IA. L’adoption désordonnée d’outils d’intelligence artificielle par les collaborateurs crée une surface d’attaque considérable que les organisations peinent à maîtriser. Les employés utilisent parfois des services d’IA non autorisés, partagent des données sensibles avec des plateformes tierces et contournent les politiques de sécurité établies, souvent sans en mesurer les conséquences. Cette gouvernance défaillante de l’IA interne représente une vulnérabilité majeure, car elle expose l’entreprise à des fuites de données et à des violations de confidentialité sans qu’aucune intrusion externe ne soit nécessaire.

Ces systèmes d’IA en entreprise présentent également des vulnérabilités intrinsèques. Les attaques par prompt injection permettent de manipuler le comportement des assistants IA en injectant des instructions malveillantes dans les documents ou données qu’ils traitent, transformant des outils légitimes en vecteurs d’attaque sans que l’utilisateur ne s’en aperçoive.

L’ingénierie sociale franchit un nouveau cap

L’IA invisibilise les signaux d’alerte habituels

L’une des évolutions les plus préoccupantes concerne le perfectionnement de l’ingénierie sociale assistée par IA. Les fautes de grammaire, les formulations maladroites et les erreurs de traduction qui trahissaient autrefois les tentatives de phishing appartiennent désormais au passé. Les modèles de langage (LLM) génèrent des communications parfaitement rédigées, contextuellement appropriées et psychologiquement manipulatrices, rendant la distinction entre message légitime et tentative d’escroquerie de plus en plus difficile.

Le clonage vocal et les deepfakes, des armes redoutables

Le clonage vocal représente aujourd’hui l’une des menaces les plus rentables pour les attaquants. Avec seulement quelques secondes d’enregistrement audio, facilement accessible via les réseaux sociaux ou les sites institutionnels, les cybercriminels peuvent reproduire la voix d’un dirigeant avec une fidélité troublante. Cette technique s’avère particulièrement efficace pour les escroqueries par téléphone (vishing, pour “voice phishing”), ciblant notamment les processus de validation de virements et les autorisations de transactions sensibles.

Les deepfakes vidéo gagnent également en qualité, bien que leur coût de production reste plus élevé. Toutefois, selon Bitdefender, ces techniques sont réservées aux attaques visant des cibles à fort potentiel lucratif.

Les techniques qui abusent de la confiance des utilisateurs gagnent du terrain

Parallèlement à ces innovations technologiques, des techniques simples mais efficaces comme ClickFix continuent de contourner les défenses techniques en abusant de la confiance des utilisateurs envers les interfaces familières. Ces attaques reposent sur des scénarios crédibles qui incitent les victimes à exécuter volontairement du code malveillant, pensant résoudre un problème technique légitime. En présentant de faux messages d’erreur système ou des notifications de mise à jour factices, les attaquants exploitent les réflexes des internautes, les transformant en complices involontaires de leurs propres infections.

Les ransomwares automatisent leurs opérations

Un écosystème criminel structuré comme une entreprise

Le Ransomware-as-a-Service (RaaS) fonctionne comme un véritable modèle commercial organisé, réunissant développeurs, affiliés et fournisseurs d’outils au sein d’un écosystème nébuleux mais structuré. Tous ces acteurs travaillent selon une logique d’efficacité : “maximiser l’impact et minimiser le temps et les efforts nécessaires à la perturbation”, ainsi que l’écrit Dmitry Volkov. Des groupes comme DragonForce incarnent déjà cette industrialisation avec leur modèle de marque blanche qui démocratise l’accès aux attaques sophistiquées.

L’IA abaisse la barrière d’entrée pour les affiliés

Les agents IA s’intègrent progressivement dans les offres RaaS, rendant des capacités automatisées avancées accessibles même aux affiliés peu qualifiés. Une fois l’intrusion établie dans le réseau de leur proie, ces agents prennent en charge la reconnaissance interne, l’élévation de privilèges et la préparation du chiffrement sans nécessiter d’expertise technique approfondie.

L’automatisation actuelle couvre déjà le chiffrement rapide des infrastructures virtualisées, la destruction automatique des sauvegardes et la désactivation des solutions de défense. L’intégration de l’IA amplifie cette dynamique en permettant aux groupes criminels de mener plusieurs opérations simultanées avec un minimum de ressources humaines, élargissant ainsi le vivier d’acteurs capables de mener des campagnes d’envergure.

L’extorsion se diversifie et se perfectionne

Du chiffrement simple aux stratégies multi-facettes

Le modèle d’extorsion basé uniquement sur le chiffrement recule face à des approches combinant vol de données, menace de publication, chiffrement sélectif et parfois attaques par déni de service (DDoS). Cette approche hybride démultiplie la pression exercée sur les victimes en exploitant simultanément plusieurs vulnérabilités.

Le modèle d’extorsion basé uniquement sur le chiffrement recule. La double extorsion, combinant chiffrement et vol de données avec menaces de publication, a ouvert la voie à des stratégies encore plus sophistiquées : chiffrement sélectif, exfiltration massive et parfois attaques par déni de service (DDoS). Cette approche hybride démultiplie la pression exercée sur les victimes en exploitant simultanément plusieurs vulnérabilités.

Les cybercriminels poussent cette logique encore plus loin. Chez Resilience, Tom Egglestone observe que les groupes ne ciblent désormais plus une seule organisation, mais compromettent en même temps l’entreprise, ses filiales, ses fournisseurs et parfois ses clients. Ce maillage de pressions croisées accélère les dommages réputationnels et opérationnels, rendant la position de la victime intenable tout en augmentant significativement la probabilité de paiement.

L’extorsion sans chiffrement gagne du terrain

Le Dr Ann Irvine, Chief Data and Analytics Officer chez Resilience, constate l’apparition d’une tendance : les acteurs malveillants renoncent de plus en plus au chiffrement pour exiger directement de l’argent en échange de la non-divulgation des données volées. Cela modifie alors la nature de la menace. Les stratégies de récupération traditionnelles, notamment les sauvegardes, deviennent inefficaces face au risque d’exposition publique d’informations sensibles comme les données clients, les secrets industriels ou les communications confidentielles.

La supply chain, talon d’Achille des organisations

La supply chain devient un vecteur d’attaque important. Les attaquants l’ont compris : compromettre un prestataire disposant d’accès privilégiés à de multiples clients représente un investissement bien plus rentable que de cibler individuellement chaque organisation. Une seule intrusion chez un fournisseur peut se propager vers des dizaines d’entreprises clientes. Les infrastructures mutualisées (cloud, SaaS, services managés) attirent de plus en plus l’attention des attaquants.

Soudoyer un collaborateur pour contourner les défenses

Recorded Future signale une multiplication des tentatives de recrutement d’employés par les groupes ransomware. Ces derniers proposent de l’argent à des collaborateurs en échange d’identifiants ou d’informations sensibles. Un journaliste de la BBC a ainsi été directement approché par des cybercriminels. Cette approche contourne entièrement les défenses techniques en exploitant la vulnérabilité humaine.

Les attaques AiTM automatisées par l’IA

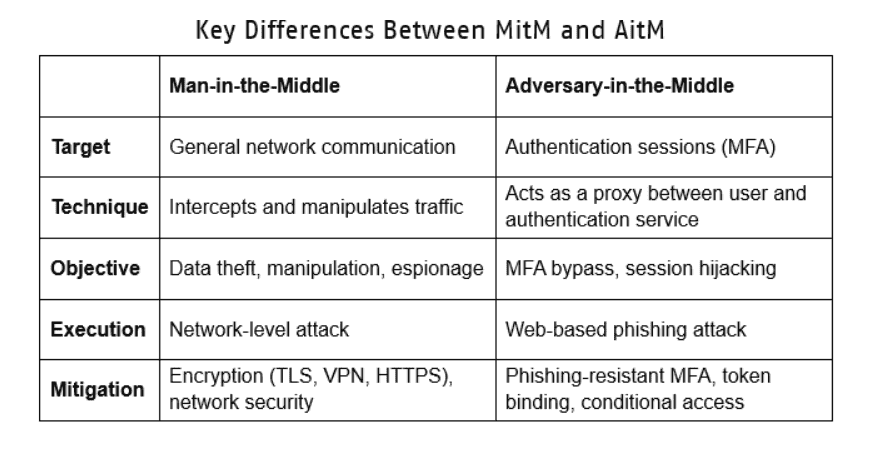

Quand l’authentification multi-facteurs ne suffit plus

Les attaques Adversary-in-the-Middle (AiTM) gagnent en popularité auprès des cybercriminels. Ces attaques ne se contentent pas de voler des identifiants, elles interceptent et exploitent les sessions déjà authentifiées. Lorsqu’un utilisateur se connecte légitimement à un service protégé par authentification multi-facteurs, l’attaquant capte le token de session valide et l’utilise pour accéder aux systèmes sans jamais avoir besoin du mot de passe ou du second facteur. En janvier 2026, Microsoft a documenté une campagne AiTM multi-étapes ciblant le secteur de l’énergie, où un seul compte compromis a permis d’envoyer plus de 600 e-mails de phishing via SharePoint.

Actuellement, ces opérations AiTM nécessitent une gestion manuelle importante pour maintenir la persistance des sessions compromises et contourner les mécanismes d’authentification. Mais l’intégration de l’IA dans ces frameworks change la donne. En 2026, selon Group-IB, les attaquants intégreront l’IA pour automatiser le détournement de sessions et la collecte d’identifiants à grande échelle. Les systèmes de vérification que nous utilisons aujourd’hui, authentification à deux facteurs, biométrie, systèmes sans mot de passe, deviendront inefficaces face à des opérations AiTM pilotées par IA, plus adaptatives que les défenses actuelles. Seules les méthodes d’authentification phishing-résistantes comme FIDO2/WebAuthn, qui lient l’authentification au dispositif via cryptographie à clé publique, peuvent résister aux attaques AiTM, car aucun identifiant ou token n’est transmis sur le réseau.

Les APIs cloud, nouvelle surface d’attaque massive

Quand l’automatisation cloud devient une vulnérabilité

Les entreprises modernes s’appuient massivement sur les écosystèmes cloud et API pour débloquer croissance et efficacité. Les APIs, conçues pour l’automatisation, permettent d’orchestrer des opérations à une échelle sans précédent grâce à leurs interfaces contrôlées par machine. Mais cette efficacité comporte un revers : les menaces pilotées par IA peuvent également exploiter ces mêmes interfaces. En 2025, Palo Alto Networks a constaté une augmentation de 41% des attaques visant les APIs, une tendance directement liée à l’explosion de l’IA agentique qui s’appuie massivement sur ces interfaces.

Les environnements cloud sont contrôlés par code. Permissions, stockage, paramètres réseau et politiques de sécurité sont définis via des APIs, ce qui rend ces configurations machine-readable. L’intelligence artificielle peut donc comprendre et même modifier les configurations cloud en exploitant ces APIs. Les attaquants cibleront cette couche automatisée pour provoquer des perturbations massives, exposer des surfaces de contrôle ou altérer des configurations critiques. Gartner, leader mondial de la recherche en technologies et cybersécurité, prédit même que d’ici 2026, 80% des violations de données impliqueront des APIs insécures, faisant de cette couche d’automatisation le maillon faible le plus critique des infrastructures cloud.

Cette dynamique crée un nouveau champ de bataille où les APIs donnent aux deux camps, attaquants et défenseurs, la capacité de multiplier leurs opérations de manière illimitée dans le cloud. L’avantage reviendra à celui qui dispose de la puissance de calcul et des ressources nécessaires pour exploiter cette scalabilité.

Attaques OAuth : l’effet domino entre applications cloud

Les environnements SaaS interconnectés créent un réseau de confiance entre applications : Microsoft 365, Google Workspace, Slack et Salesforce échangent des autorisations via OAuth. Les compromissions OAuth exploitent précisément ce maillage de confiance. Un attaquant qui pousse un utilisateur à accorder des permissions à une application malveillante obtient un point d’ancrage légitime. Cette application compromise peut ensuite se propager latéralement entre services en exploitant les relations de confiance existantes, sans nécessiter de mots de passe ni d’authentification multi-facteurs.

Cette menace a pris une dimension concrète en août 2025 avec la compromission de l’application Salesloft Drift. Les attaquants ont exploité des jetons OAuth volés pour accéder à des centaines d’instances Salesforce et à des comptes Google Workspace, démontrant comment une seule application compromise peut contaminer l’ensemble d’un écosystème SaaS d’entreprise en quelques heures.

Les backdoors invisibles dans le code assisté par IA

L’intelligence artificielle transforme les pratiques de développement logiciel. Les assistants de codage accélèrent considérablement la production, mais la confiance croissante accordée au code généré par IA réduit la rigueur des revues. De nombreuses équipes permettent désormais au code d’atteindre les environnements de production plus rapidement, en négligeant les vérifications approfondies qui auraient détecté des anomalies.

Cette évolution amplifie les risques d’attaques de supply chain. Les adversaires insèrent des backdoors difficiles à détecter dans des logiciels légitimes et des bibliothèques populaires utilisées par des milliers de développeurs. Avec la montée en puissance des outils de codage assistés par IA, les acteurs étatiques pourraient tenter d’influencer ou de manipuler ces systèmes pour intégrer des backdoors et des vulnérabilités à grande échelle.

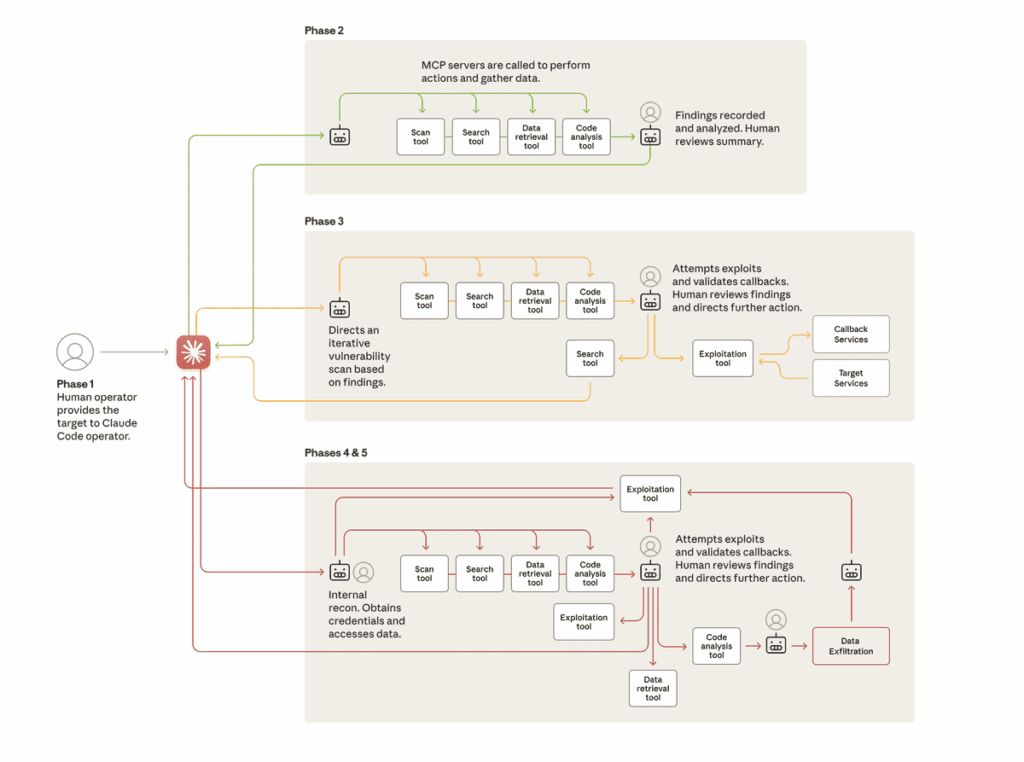

Group-IB souligne que cette combinaison, adoption généralisée et examen réduit, représente pour les adversaires une opportunité évolutive de compromettre les systèmes et les pipelines de développement, une opportunité qu’ils ne négligeront probablement pas. Cette prédiction s’est matérialisée de manière spectaculaire en septembre 2025, lorsqu’Anthropic a détecté et neutralisé la première cyberattaque orchestrée par IA à grande échelle. Un acteur malveillant avait manipulé Claude Code pour infiltrer une trentaine d’organisations mondiales de manière quasi-autonome, démontrant que la menace des backdoors assistés par IA n’est pas que théorique.

La réponse défensive s’organise

SOC unifiés et centres de fusion cyber-fraude

Face à l’accélération des attaques pilotées par IA, les Security Operations Centers investissent massivement dans l’automatisation intelligente pour détecter et répondre aux menaces à vitesse compétitive. Cette évolution impose une collaboration interne quasi temps réel pour combler les lacunes de sécurité.

Les SOC traditionnels, organisés autour d’outils disparates générant d’énormes volumes d’alertes, créent des silos de réponse. Ce modèle cède progressivement la place aux Cyber Fraud Fusion Centers. Ces équipes hybrides et interfonctionnelles améliorent considérablement la gestion des risques grâce à des données partagées, des tableaux de bord offrant une visibilité connectée, des modèles automatisés centralisés pour normaliser et corréler les informations, et des boucles de rétroaction en temps réel permettant d’agir instantanément dès les premiers signes de menace.

L’intelligence artificielle y joue un rôle central pour automatiser le triage et l’enrichissement des alertes, permettant aux analystes de se concentrer sur les investigations complexes nécessitant jugement et créativité. Les mots-clés de cette transformation : continu, temps réel, collaboratif.

La transparence de l’IA, un impératif de confiance

Les systèmes d’IA prendront de plus en plus de décisions de sécurité autonomes. Mais le manque de supervision peut devenir préjudiciable, conduisant à des biais, des classifications erronées et des défaillances éthiques. La transparence et l’auditabilité de l’IA, ce que les anglophones nomment “Explainable AI” (XAI), va passer du statut d’option à celui d’impératif non négociable pour les organisations qui déploient sérieusement des capacités IA en sécurité.

Cette transparence doit s’appliquer aux données d’entraînement pour prévenir l’empoisonnement, à la logique de décision pour éviter les biais exploitables, et au processus de validation des résultats pour que les analystes comprennent pourquoi le modèle a agi d’une certaine manière. Malgré l’empressement des entreprises à intégrer l’IA, la plupart ne sont pas prêtes à lui faire entièrement confiance. Le problème de la boîte noire, les vulnérabilités supplémentaires et les risques de conformité ont fait de l’adoption rapide de l’IA un risque majeur.

Dmitry Volkov précise que : cela déplace la question centrale en matière de sécurité de « Où utilisez-vous l’IA ? » à « Que laissez-vous l’IA décider et pouvez-vous l’expliquer ? ».

Les enjeux de demain

L’année 2026 ne marquera pas une rupture brutale, mais l’accélération de tendances déjà à l’œuvre. L’intelligence artificielle amplifie les capacités des attaquants comme des défenseurs, créant une course où l’automatisation devient indispensable. Les ransomwares poursuivent leur professionnalisation, exploitant méthodiquement les maillons faibles pour maximiser leur rentabilité. Les infrastructures numériques supportent une pression croissante qui reflète leur importance stratégique.

Les organisations qui réussiront seront celles qui auront abandonné le paradigme de la prévention absolue pour adopter une posture de résilience. Plutôt que chercher à empêcher toute intrusion, elles se préparent à être compromises et construisent leur capacité à détecter rapidement, contenir efficacement et restaurer complètement leurs opérations. Cette approche implique des sauvegardes véritablement isolées, des plans de continuité testés régulièrement et une compréhension claire des dépendances critiques.

La maîtrise du risque tiers nécessite un changement radical : surveillance continue de la posture de sécurité des fournisseurs, cartographie précise des impacts potentiels et plans de contingence permettant de maintenir les opérations même lors d’un incident majeur chez un prestataire. La quantification précise de l’exposition dépasse les évaluations de conformité superficielles pour intégrer les pertes opérationnelles réelles, l’érosion de la confiance client et les conséquences réglementaires.

Enfin, les fondamentaux conservent toute leur pertinence : authentification multi-facteurs rigoureuse, segmentation réseau, application systématique des correctifs et formation continue. Les technologies avancées ne compensent pas des bases fragiles. Les organisations qui ont établi une hygiène de sécurité solide seront les seules à pouvoir tirer pleinement parti des capacités défensives offertes par l’IA. Les risques ne sont pas des scénarios hypothétiques. Ils frappent aujourd’hui les organisations qui n’étaient pas préparées à cette nouvelle normalité de la menace cyber.

Sources

Group-IB : Stranger Threats Are Coming: Group-IB Cyber Predictions for 2026 and Beyond

Lumu : Cybersecurity Predictions 2026: The Post-Malware & AI Era

Bitdefender : Cybersecurity Predictions 2026: Hype vs. Reality

Cyber Resilience : Cybersecurity and Insurance Predictions 2026

Recorded Future : Ransomware Tactics 2026

BBC News : Ransomware gang tries to hire journalist as insider

SecurityWeek : Cyber Insights 2026: API Security – Harder to Secure, Impossible to Ignore

Microsoft Security Blog : Multistage AiTM phishing and BEC campaign abusing SharePoint

MITRE ATT&CK® : Adversary-in-the-Middle

Swissbit : Bypassing MFA: The Rise of Adversary-in-the-Middle (AitM) Attacks

Palo Alto Networks : Palo Alto Networks Report Reveals AI Is Driving a Massive Cloud Attack Surface Expansion

Wowrack : Preparing for 2026 Cloud Threats: A Guide to Cloud Security Trends and Risk Management

Google Cloud Blog : Widespread Data Theft Targets Salesforce Instances via Salesloft Drift

Anthropic : Disrupting the first reported AI-orchestrated cyber espionage campaign

Google Cloud : Cybersecurity Forecast 2026 report